Google, yerel kullanım için optimize edilmiş dört farklı boyutta sunulan Gemma 4'ü tanıttı. Geliştiriciler, Gemma 4 ile çalışmaya başlayabilecek. Hatta Gemma 4'ün önceki modellere kıyasla yeni bir lisans ile karşımıza çıkması, onu geliştiriciler için daha cazip hale getirebilir.

Önceki Gemma sürümlerinde kullanılan özel lisans, çok kısıtlayıcı olması konusunda eleştiriliyordu. Bu nedenle Google, özel Gemma lisansını kaldırıyor. Şirket, Qwen, Mistral ve Arcee gibi şirketler ve geliştiriciler tarafından yaygın olarak kullanılan Apache 2.0 lisansına geçiyor. Qwen3.5 Omni ve Qwen 3.6 Plus ile Alibaba da dahil olmak üzere bazı Çin merkezli yapay zeka laboratuvarları en yeni modelleri için tamamen açık sürümlerden geri çekilmeye başlarken, Google tam tersi yönde ilerliyor.

Google, Gemma 4'ü yerel cihazlarda kullanılabilecek şekilde tasarladı. İki büyük Gemma varyantı olan 26B Mixture of Experts ve 31B Dense, tek bir 80 GB Nvidia H100 GPU üzerinde bfloat16 formatında nicelleştirilmemiş (unquantized) olarak çalışacak şekilde tasarlandı. Daha düşük hassasiyetle çalışmak üzere nicelleştirildiğinde (quantized) ise bu büyük modeller tüketici sınıfı GPU'lardan destek alabilir.

Google'ın belirttiğine göre şirket, Gemma'nın yerel işlem gücünden gerçekten yararlanmak için gecikmeyi azaltmaya odaklandı. 26B Mixture of Experts modeli, çıkarım modunda 26 milyar parametresinden sadece 3,8 milyarını etkinleştiriyor. Böylece benzer boyutlardaki modellere göre çok daha yüksek saniye başına token sayısı sağlıyor. Öte yandan, 31B Dense ise hızdan çok kaliteye odaklanıyor.

Google'ın mobil odağında yapay zeka atılımları

Mobil cihazlara yönelik olan diğer iki Gemma 4 modeli Effective 2B (E2B) ve Effective 4B (E4B), çıkarım sırasında düşük bellek kullanımı sağlamak üzere tasarlandı. Söz konusu modellerin etkin olarak 2 milyar veya 4 milyar parametre ile çalıştığını belirtelim.

Google'ın paylaştığı bilgilere göre; Pixel ekibi bu modelleri akıllı telefonlar, Raspberry Pi ve Jetson Nano gibi cihazlar için optimize etmek üzere Qualcomm ve MediaTek ile çalıştı. Bu modeller sadece Gemma 3'ten daha az bellek ve pil tüketmenin ötesinde “sıfıra yakın gecikme” özelliğiyle de öne çıkıyor.

E2B ve E4B'nin piyasaya sürülmesi, Google'ın akıllı telefon odağındaki yapay zeka çalışmalarının nereye doğru gittiğini gözler önüne seriyor. Pixel'ler ve bazı diğer Android telefonlar, verileri buluta göndermeden dolandırıcılık tespiti, not özetleme ve arama özeti gibi görevleri yerine getirebilen Gemini Nano adlı yerel yapay zeka modellerini çalıştırıyor.

Google, yaptığı bir açıklamada Gemini Nano'nun her zaman Gemma modellerinden türetildiğini ve bir sonraki nesil Nano 4'ün de Gemma 4 E2B ile E4B'ye dayanan 2B ve 4B varyantlarına sahip olacağını doğruladı. Şirket, geliştiricileri bu modellerle şimdiden agentic iş akışları geliştirmeye davet ediyor. Söz konusu sistemler ilerleyen süreçte Gemini Nano 4 ile de uyumlu çalışacak. Konuya dair detayların Google I/O'da paylaşılması bekleniyor.

Gemma 4'ün öne çıkan yetenekleri

Gemma 4, geliştirilmiş akıl yürütme, matematik ve talimatları takip etme yetenekleri sunuyor. Gemma 4, yerel işlev çağrısı, yapılandırılmış JSON çıktısı ve yaygın araçlar ile API'ler için yerel talimat desteği ile yapay zeka şirketlerinin sunduğu agentic iş akışları trendine hazır.

Gemma 4'ün kod üretimi için de optimize edildiğini ekleyelim. Google'ın belirttiğine göre, daha büyük varyantları çalıştıracak donanıma sahip olmanız halinde, Gemma 4 çevrimdışı bir ortamda da yüksek kaliteli kod üretebiliyor. Şirketin paylaştığına göre; Gemma 4, görsel girdileri işleme konusunda da daha iyi performans sergiliyor. Ayrıca verimli E2B ve E4B modellerinin konuşma tanıma için yerel desteğe sahip olduğunu da belirtelim.

Önceki nesil açık modellerde çok modluluğun genellikle bir eklenti olarak ele alındığı görülüyordu. Önceki nesilde görsel kodlayıcılar, metin omurgalarına eklenirken, ses için Whisper gibi harici bir ASR boru hattı kullanılması gerekiyordu. Aynı şekilde işlev çağrısı da komut satırı mühendisliğine dayanmaktaydı. Gemma 4'te bahsi geçen yetenekler mimari düzeyde entegrasyon ile karşımıza çıkıyor. Üstelik model, tüm bu yetenekleri 140'tan fazla dilde sunuyor. Buna ek olarak uç modellerin bağlam penceresinin 128 bin token, 26B ve 31B modellerinin ise 256 bin token olarak karşımıza çıktığını belirtmekte fayda var.

Gemma 4'ün performansı

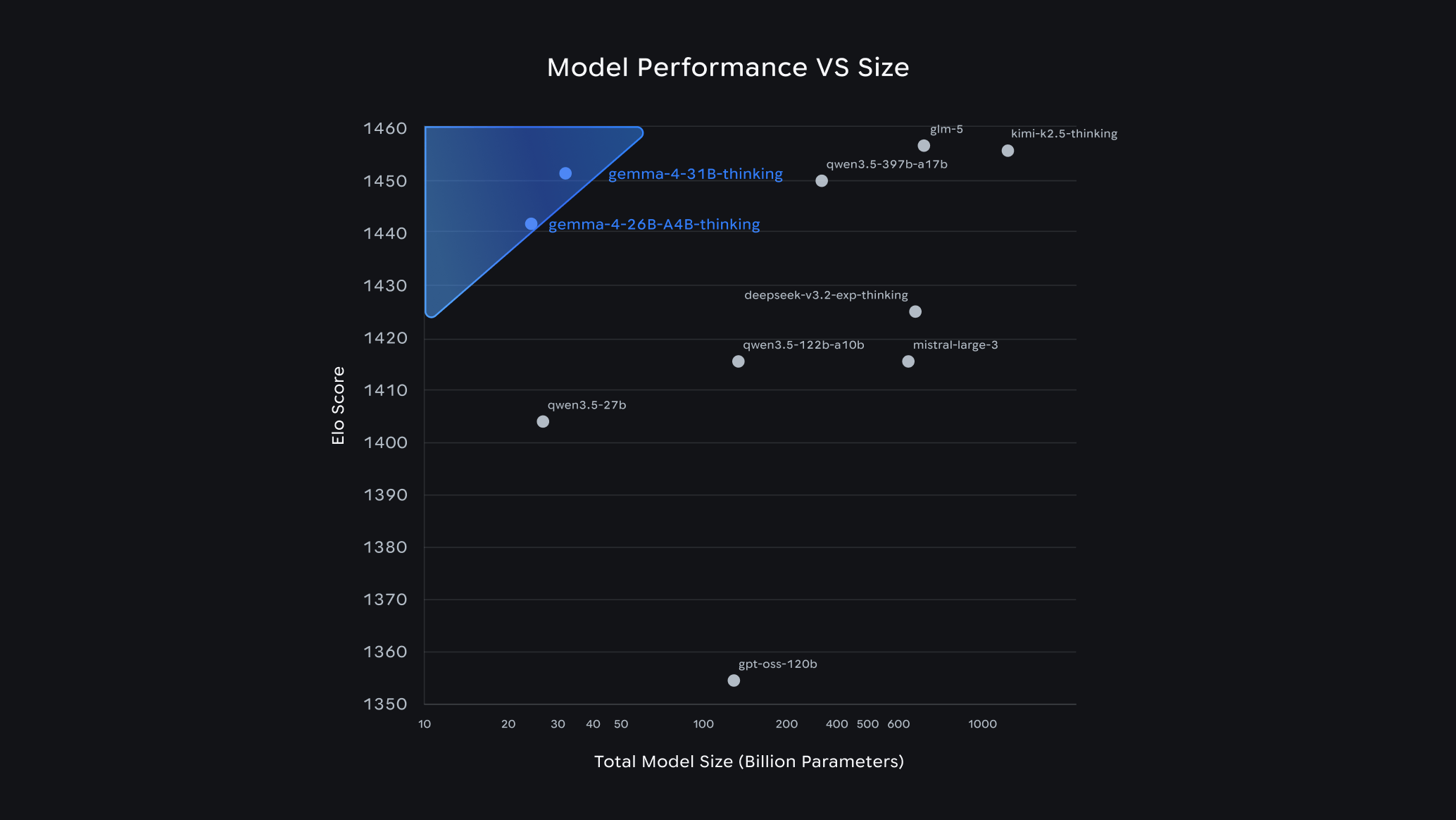

Şirket, tüm yeni Gemma 4 modellerinin Gemma 3'ü geride bırakacağını belirtiyor. Google'ın ifadesine göre; Gemma 31B, en iyi açık AI modellerinin yer aldığı Arena listesinde GLM-5 ve Kimi 2.5'in ardından üçüncü sırada yer alacak. Bununla birlikte en büyük Gemma 4 varyantının bile bu modellerin boyutunun sadece bir kısmı kadar olduğunu belirtelim. Yani teorik olarak Gemma 4 modellerini çalıştırmak GLM-5 ve Kimi 2.5'ten çok daha ucuz olabilir.

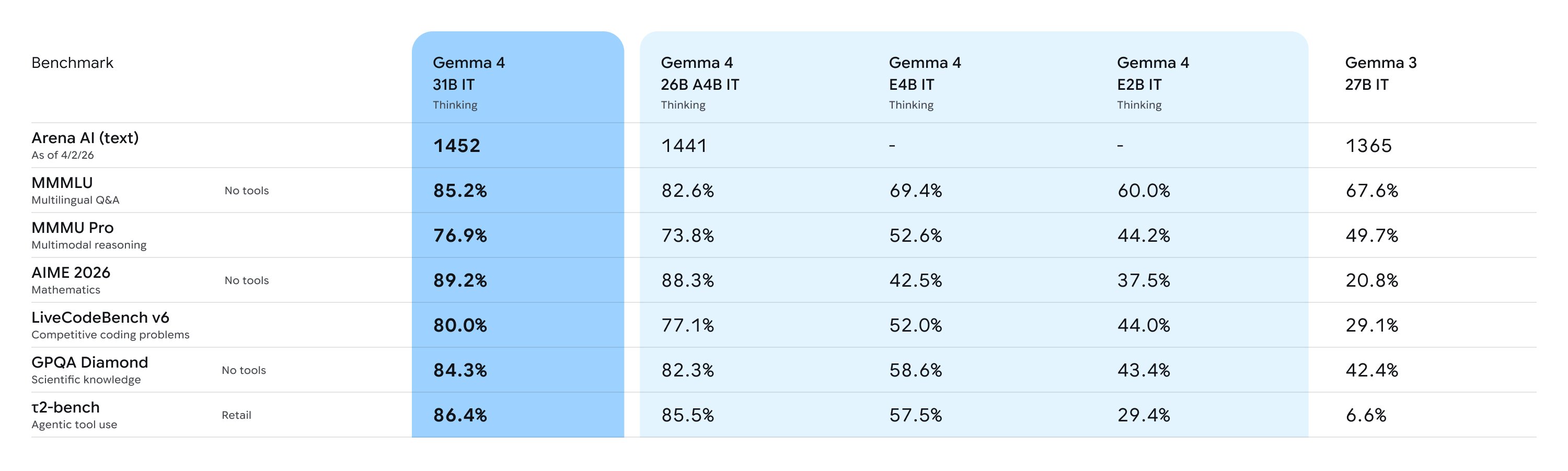

Karşılaştırma sonuçlarına bakıldığında 31B modeli, matematiksel akıl yürütme testi AIME 2026'da yüzde 89,2, LiveCodeBench v6'da yüzde 80,0 puan alıyor. Codeforces ELO'da 2.150'e ulaşan model, Görme alanında MMMU Pro'da yüzde 76,9'a ulaşırken MATH-Vision'da yüzde 85,6 puan aldı.

Gemma 4'ün MoE modeli ise AIME 2026'da yüzde 88,3, LiveCodeBench'te yüzde 77,1 ve lisansüstü düzeyde bir bilimsel akıl yürütme karşılaştırması olan GPQA Diamond'da yüzde 82,3 sonuçlarını elde etti.

31B ve 26B MoE varyantlarını içeren yeni Gemma modellerine AI Studio üzerinden 31B ve 26B MoE varyantlarına; E4B ve E2B varyantlarına ise AI Edge Gallery üzerinden erişebilirsiniz. Ayrıca model ağırlıkları Hugging Face, Kaggle ve Ollama'dan tam olarak indirilebiliyor. Modeller yerel işleme için optimize edilmiş olsa da, Google Cloud'da da çalıştırabiliyorsunuz.

İlk Yorumu yazmak ister misiniz?

Yorum Yazmak için Giriş Yap