OpenAI, açık ağırlıklı yeni dil modelleri GPT-OSS-120B ve GPT-OSS-20B'yi tanıttı. Apache 2.0 lisansı altında erişime açılan bu iki model, gerek akıl yürütme performansı gerekse donanım verimliliği açısından dikkat çekici sonuçlar sunuyor. OpenAI, bu modelleri düşük maliyetle güçlü çıktı almak isteyen geliştiriciler, kurumlar ve araştırmacılar için yayınlıyor.

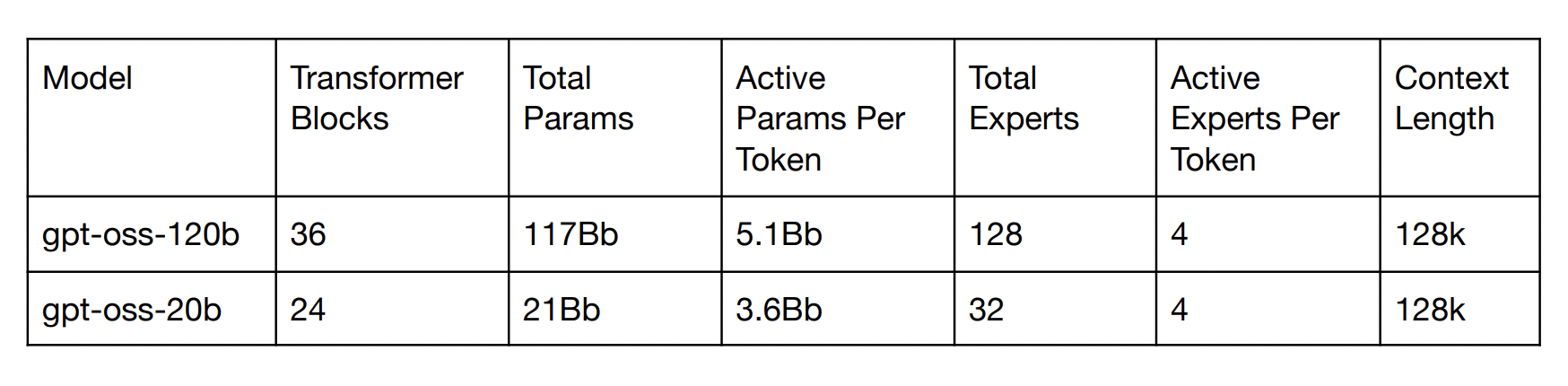

Transformer tabanlı olan her iki modelde de mixture-of-experts (MoE) yaklaşımı tercih edilmiş. Bu sayede modele verilen her bir girdi için aktif parametre sayısı azaltılarak verimlilik artırılıyor.

- GPT-OSS-120B: Toplam 117 milyar parametre, her token için 5.1 milyar aktif parametre

- GPT-OSS-20B: Toplam 21 milyar parametre, her token için 3.6 milyar aktif parametre

Her iki model de 128 bin token'a kadar bağlam uzunluğunu destekliyor. Ayrıca RoPE (Rotary Positional Embedding) pozisyon kodlaması, multi-query attention ve sparse attention gibi tekniklerle bellek ve hesaplama verimliliği artırılmış.

Donanım uyumluluğu

GPT-OSS-120B, 80 GB belleğe sahip bir GPU üzerinde çalışabiliyor. GPT-OSS-20B ise sadece 16 GB belleğe ihtiyaç duyuyor ve Edge cihazlarda kullanılmaya uygun. Modeller MXFP4 formatında önceden kuantize edilmiş olarak Hugging Face üzerinden indirilebiliyor. PyTorch ve Apple Metal için örnek çalıştırma kodları da yayımlanmış durumda.

Yüksek akıl yürütme ve araç kullanımı performansı

Modeller, OpenAI'ın o3, o3-mini ve o4-mini modelleriyle karşılaştırıldığında; kod yazma (codeforces), akademik genel bilgi (MMLU, HLE), matematik (AIME 2024–2025), sağlık alanı (HealthBench), araç çağırma ve fonksiyon kullanımı (TauBench) gibi değerlendirme testlerinde oldukça yüksek skorlar aldı. Özellikle GPT-OSS-120B modeli, o4-mini'ye yakın veya daha iyi performans gösteriyor. Daha küçük olan 20B modeli ise o3-mini'yi birçok testte geçmeyi başarıyor.

CoT (Chain-of-Thought) ve denetimsiz düşünce takibi

Modellerin zincirleme düşünme yetenekleri (CoT) özel olarak denetimsiz biçimde geliştirildi. Bu yaklaşım, modelin potansiyel kötüye kullanım, yanıltıcı cevaplar ya da hatalı akıl yürütme süreçlerini dışarıdan takip edilebilir kılıyor. OpenAI, geliştiricilerin bu düşünce zincirlerini son kullanıcıya göstermemesini öneriyor.

Kötüye kullanım senaryolarına karşı testler yapıldı

OpenAI, modellerin güvenliği için çeşitli aşamalarda özel önlemler aldı. Ön eğitim sırasında kimyasal, biyolojik, radyolojik ve nükleer (CBRN) içerikler filtrelendi. Sonradan eğitim sürecinde modelin zararlı taleplere karşı dirençli hale gelmesi sağlandı. Ayrıca, kötü niyetli bir saldırganın modeli kötüye kullanabileceği senaryolar test edildi. Bu testlerde biyoloji ve siber güvenlik gibi alanlara özel, reddetmeyen versiyonlar eğitildi. Sonuçlar, bu modellerin yeteneklerinin sınırlı kaldığını gösterdi. Bu süreç, dış bağımsız uzmanlar tarafından da denetlendi. Güvenlik araştırmalarını teşvik etmek amacıyla OpenAI, toplam 500 bin dolarlık ödül havuzuna sahip bir Red Teaming yarışması da başlattı.

Erişilebilirlik ve dağıtım seçenekleri

Modelleri yerel cihazlarda çalıştırmak isteyen geliştiriciler için; Hugging Face, Azure, AWS, Databricks, Vercel, Cloudflare gibi platformlarda dağıtım destekleniyor. Donanım tarafında ise NVIDIA, AMD, Cerebras, Groq ile optimizasyon çalışmaları yürütüldü. Microsoft, GPT-OSS-20B modelinin ONNX Runtime ile optimize edilmiş versiyonlarını Windows cihazlara taşıyor. VS Code ve Foundry Local üzerinden erişilebiliyor.

İlk Yorumu yazmak ister misiniz?

Yorum Yazmak için Giriş Yap