Meta'nın mobil cihazlar için görece daha kompakt büyük dil modeli MobileLLM'den geçtiğimiz günlerde bahsetmiştik. Büyük dil modellerine kıyasla daha küçük parametreli kompakt modeller gün geçtikçe daha popüler hale geliyor. Yapay zeka topluluğu şirketi Hugging Face de dün kompakt dil modelleri ailesi SmolLM'i tanıttı. SmolLM performansıyla Microsoft, Meta ve Alibaba'nın ürettiği Qwen'in diğer kompakt modellerini geride bırakmaya kararlı.

SmolLM'in performansı

SmolLM serisi, 135 milyon, 360 milyon ve 1,7 milyar parametre olmak üzere üç farklı boyuta sahip. Az yer kaplamalarına rağmen bu modeller muhakeme ve dünya bilgisi ölçütlerini test eden kıyaslamalarda rakiplerine meydan okuyan sonuçlarla karşımıza çıkıyor.

En küçük model olan SmolLM-135M, daha az token'a sahip olmasına rağmen Meta'nın MobileLM-125M modelinden daha iyi performans gösteriyor. SmolLM-360M ise 500 milyon parametrenin altındaki tüm modelleri geride bırakmayı başarıyor. Buna Meta ve Qwen'in modelleri de dahil. Son olarak platformun amiral gemisi SmolLM-1.7B modelinin, Microsoft'un Phi-1.5, Meta'nın MobileLM-1.5B ve Qwen2-1.5B modellerini birçok kıyaslamada geride bıraktığını görmekteyiz.

Eğitim verileri

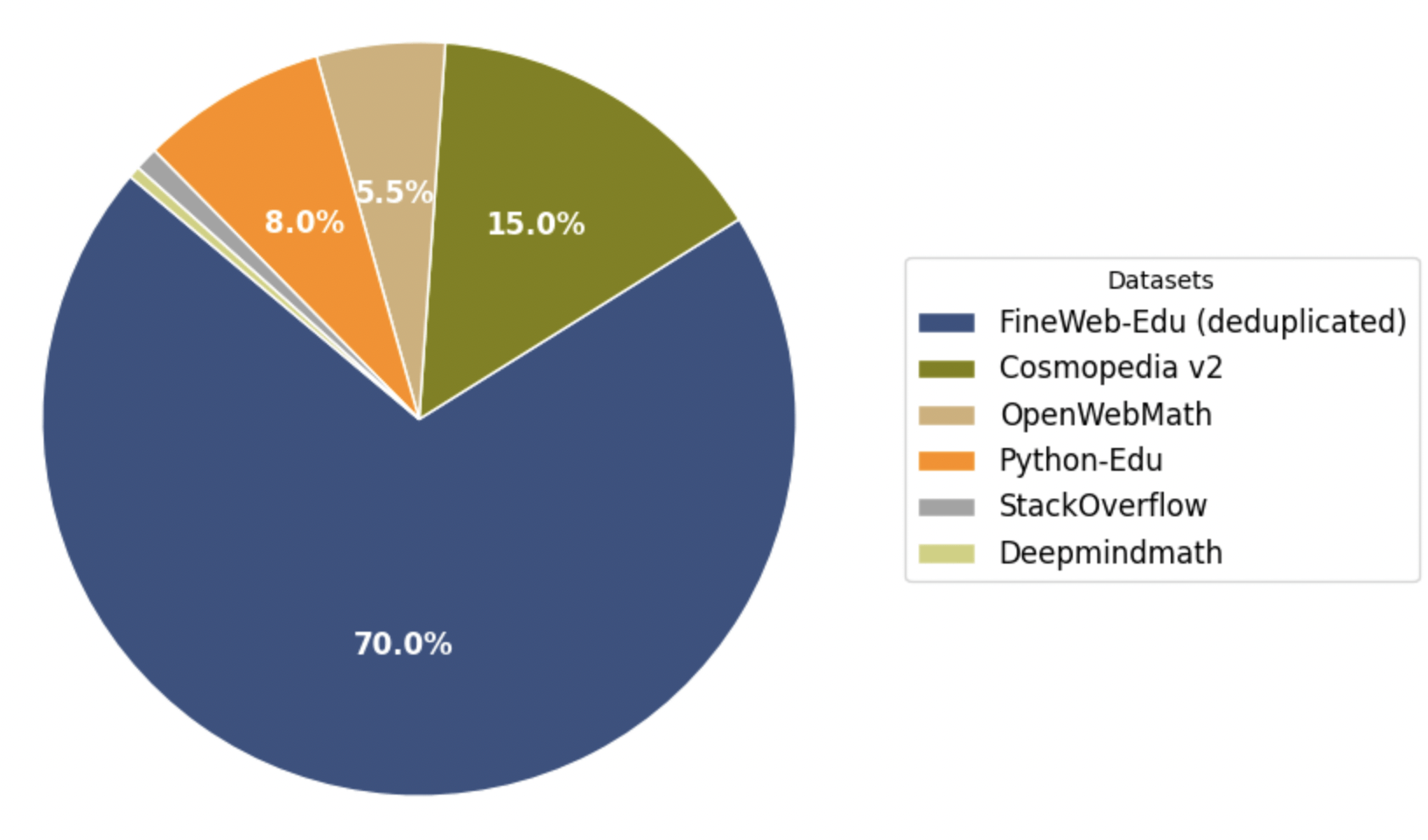

Ölçütlerdeki performansın ötesinde Hugging Face'in tüm geliştirme sürecini açık kaynaklı hale getirmesi de onu diğerlerinden ayırıyor. Kullanıcılar, veri küratörlüğünden eğitim adımlarına kadar tüm detaylara açık kaynak olarak erişebiliyor. SmolLM'in eğitim verileri arasında sentetik ders kitapları ve hikayeler içeren Cosmopedia v2, eğitici Python örnekleri bulunduran Python-Edu ve seçilmiş eğitici web içeriği FineWeb-Edu'yu içeren Cosmo-Corpus yer alıyor.

SmolLM'de baş makine öğrenimi mühendisi Loubna Ben Allal'ın aktardıklarına göre; SmolLM ile elde edilen performans veri kalitesiyle ilişkili. Bu anlamda Ben Allal, SmolLM'i ortaya çıkaran ekibin web ve sentetik verilerin bir karışımını kullanarak yüksek kaliteli verileri düzenlemek için yenilikçi yaklaşımlarla ilerlediğini ifade ediyor.

Hugging Face Araştırma Ekibi Lideri Leandro von Werra'nın ifadesine göre; SmolLM, kişiselleştirilmiş otomatik tamamlama özelliklerinden karmaşık kullanıcı isteklerini ayrıştırmaya kadar, özel yapay zeka uygulamalarını mümkün kılıyor. Üstelik bunun için pahalı GPU'lara veya bulut altyapısına ihtiyaç duyulmuyor.

Kişisel bilgisayarlar ve mobil cihazlarda çalışan bu kompakt modeller, yapay zeka erişimini artırırken, performanstan veya gizlilikten ödün vermiyor. Bu da şimdiye kadar büyük dil modellerine gösterilen ilginin yavaş yavaş kompakt modellere yöneldiğini gösteriyor.

İlk Yorumu yazmak ister misiniz?

Yorum Yazmak için Giriş Yap